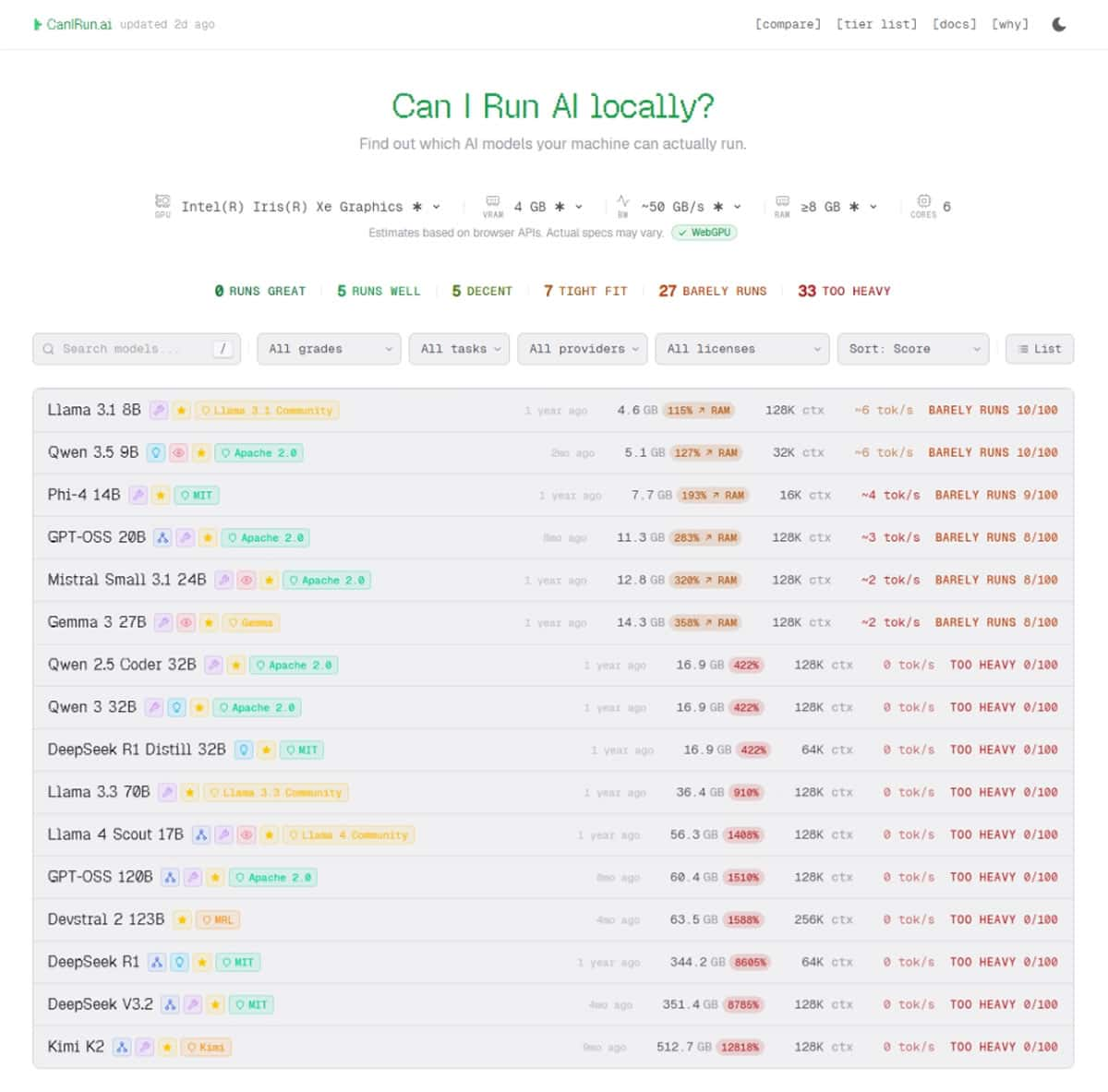

本地端跑 AI 模型這件事,越來越多人想嘗試,但最頭痛的問題就是:「我的電腦到底跑不跑得動?」這次要介紹的 CanIRun.ai 就是專門為了解決這個困擾而生的免費工具,只要打開網頁,它就會自動偵測你的電腦硬體規格,並且直接告訴你哪些 AI 模型可以順暢執行、哪些跑起來會很吃力。對想踏入本地端 AI 的使用者來說,這款工具可以省下大量摸索的時間。

根據官網的介紹,CanIRun.ai 的核心任務只有一句話:「找出你的電腦實際上能跑哪些 AI 模型。」隨著 Llama、Qwen、Gemma、DeepSeek 等開源模型大量湧現,想在自己的電腦上跑 AI 不再是夢,但每個模型對 GPU 顯存(VRAM)、系統記憶體(RAM)的需求都不同。對沒有深厚技術背景的人來說,光是看懂那些 GB 數字和量化格式就已經很困難了,更別說要一個個去查相容性。

自動偵測硬體,不用手動查規格

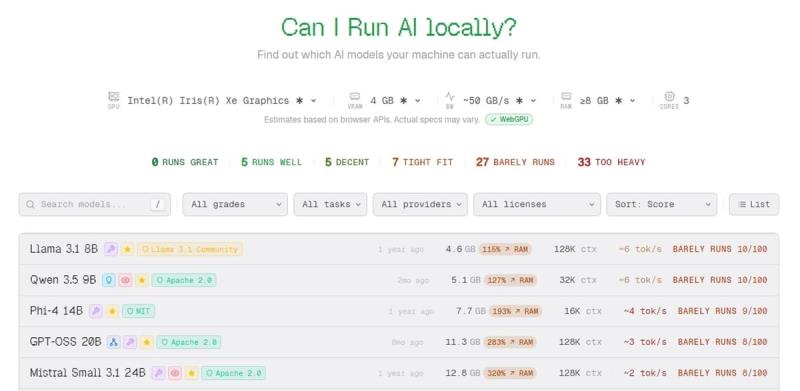

這款工具最直接的亮點,就是「開啟網頁就自動偵測」。它透過瀏覽器 API 自動讀取你的 GPU 型號、VRAM 容量、系統頻寬、RAM 大小和 CPU 核心數,整個過程不需要安裝任何軟體或外掛程式。偵測完成後,頁面上方會即時顯示你的硬體摘要,讓你一眼就知道自己的電腦配備屬於哪個等級。實際上這個設計非常友善,就算是對電腦規格完全不熟悉的使用者,也能快速上手。

🔔 不錯過任何精彩! 立即訂閱我們的 LINE 官方帳號

每次發佈新文章時,您將會第一時間收到本站文章連結通知,輕鬆掌握最新資訊!

模型評級系統:從「跑很順」到「太重了」一目瞭然

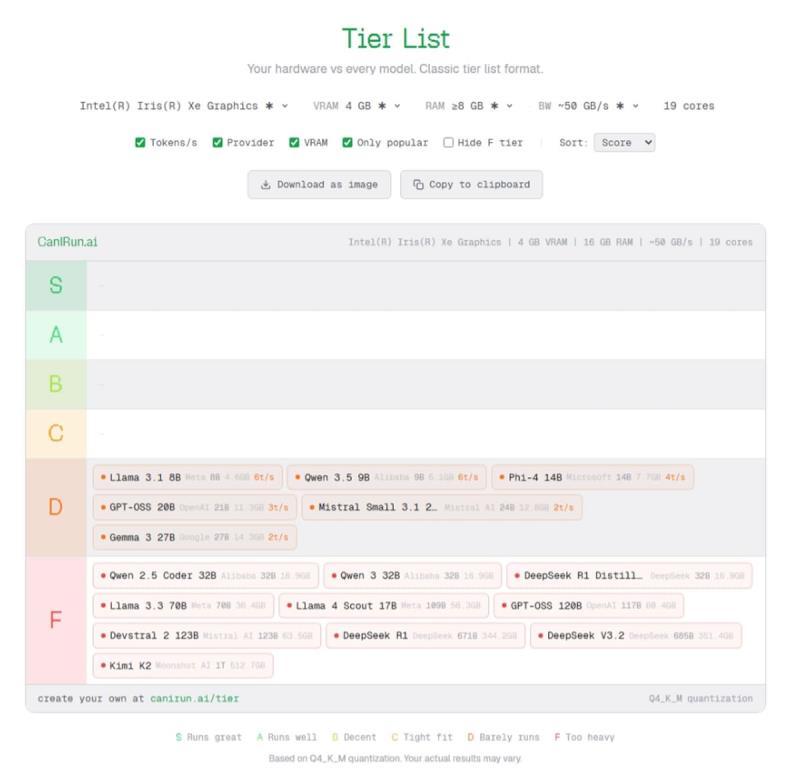

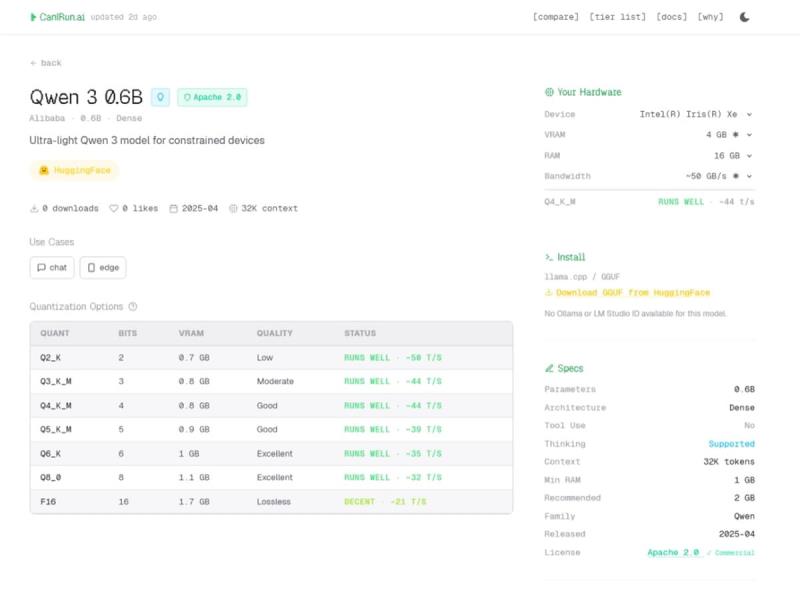

CanIRun.ai 針對每個 AI 模型,依據你的硬體規格給出六個等級的評分,分別是「跑很順(Runs great)」、「跑得不錯(Runs well)」、「還算可以(Decent)」、「勉強擠得進去(Tight fit)」、「勉強能跑(Barely runs)」和「太重了(Too heavy)」。這次的設計讓使用者不再需要自己計算 VRAM 夠不夠用,系統會根據模型的量化版本(如 Q4\_K\_M、Q8\_0 等)和你的硬體直接給出建議。對不熟悉量化格式的人來說,這個評分機制等於幫你做了所有技術判斷。

收錄模型範圍廣,從小到大都有

這款工具收錄的模型涵蓋了目前主流的開源 AI 陣容,包含 Meta 的 Llama 系列、Google 的 Gemma 系列、Alibaba 的 Qwen 系列、Mistral AI、DeepSeek、Microsoft 的 Phi 系列等多個廠商的作品。模型大小從不到 1GB 的超輕量版本,一路到數百 GB 的大型模型都有收錄,使用者可以依照用途(聊天、程式碼、推理、視覺辨識)或授權類型(商業用途、非商業用途)來篩選,找到最符合需求的選擇。實際上,光是篩選功能就能省下大量比較時間。

如何使用 CanIRun.ai?操作步驟說明

操作流程非常簡單,以下是完整步驟:

1.開啟網站:前往 CanIRun.ai,網站會自動開始偵測瀏覽器可讀取到的硬體資訊,頁面頂端會顯示 GPU、VRAM、RAM 等數值。

2.查看偵測結果:等待頁面載入完成後,模型清單會依據你的硬體自動標示每個模型的執行評級,顏色或標籤會指出哪些模型適合你。

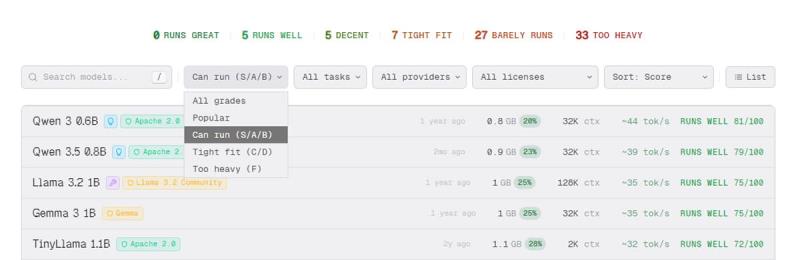

3.使用篩選功能:可以依照「用途」(聊天、程式碼、推理、視覺)、「廠商」(Meta、Google、Alibaba 等)、「授權類型」(商業或非商業)進行篩選,縮小選擇範圍。

4.b>調整排序方式:可依照評分、參數大小、發布時間、Context 長度、推論速度、VRAM 需求或熱門程度來排序,找出最符合需求的模型。

5.點入模型詳細頁:點擊任一模型名稱,可以進入該模型的詳細頁面,查看不同量化版本(Q2 到 F16)所需的 VRAM 大小,以及對應的下載或執行工具建議(如 Ollama、LM Studio)。

量化版本是什麼?看懂 Q4、Q8 不再困惑

很多人第一次看到 Q2\_K、Q4\_K\_M、Q8\_0、F16 這些代碼會一頭霧水,實際上這些都是同一個模型的不同「壓縮程度」。數字越小代表壓縮越多、檔案越小、對 VRAM 的需求也越低,但相對地,回應品質也會稍微下降。F16 則是保留完整精度的版本,效果最好但也最吃資源。對大多數使用者來說,Q4\_K\_M 通常是品質與硬體需求之間最平衡的選擇,CanIRun.ai 也會依據你的 VRAM 自動標示哪個量化版本最適合你的電腦。

適合哪些人使用?

這款工具對幾類人特別有用:第一是剛接觸本地端 AI 的新手,不知道從哪個模型開始;第二是有一定技術基礎但不想花時間一個個測試規格的開發者;第三是想確認自己的舊電腦或筆電能否應付輕量模型的一般使用者。對企業用戶來說,如果想在沒有雲端連線的環境中部署 AI,這款工具也能快速評估內部硬體的適配性,是個省時省力的前期評估幫手。

資料來源透明,數據有據可查

根據官網的介紹,CanIRun.ai 的模型數據主要來自 llama.cpp、Ollama 和 LM Studio 這三個廣受社群信賴的開源工具與平台,資料來源公開透明,不是憑空估算。這款工具由開發者 midudev 為本地端 AI 社群所打造,目前完全免費使用,不需要註冊帳號,也沒有任何使用限制。對想要開始嘗試本地端 AI 的人來說,這次能找到這樣一個簡單直覺又免費的工具,算是相當難得的資源。