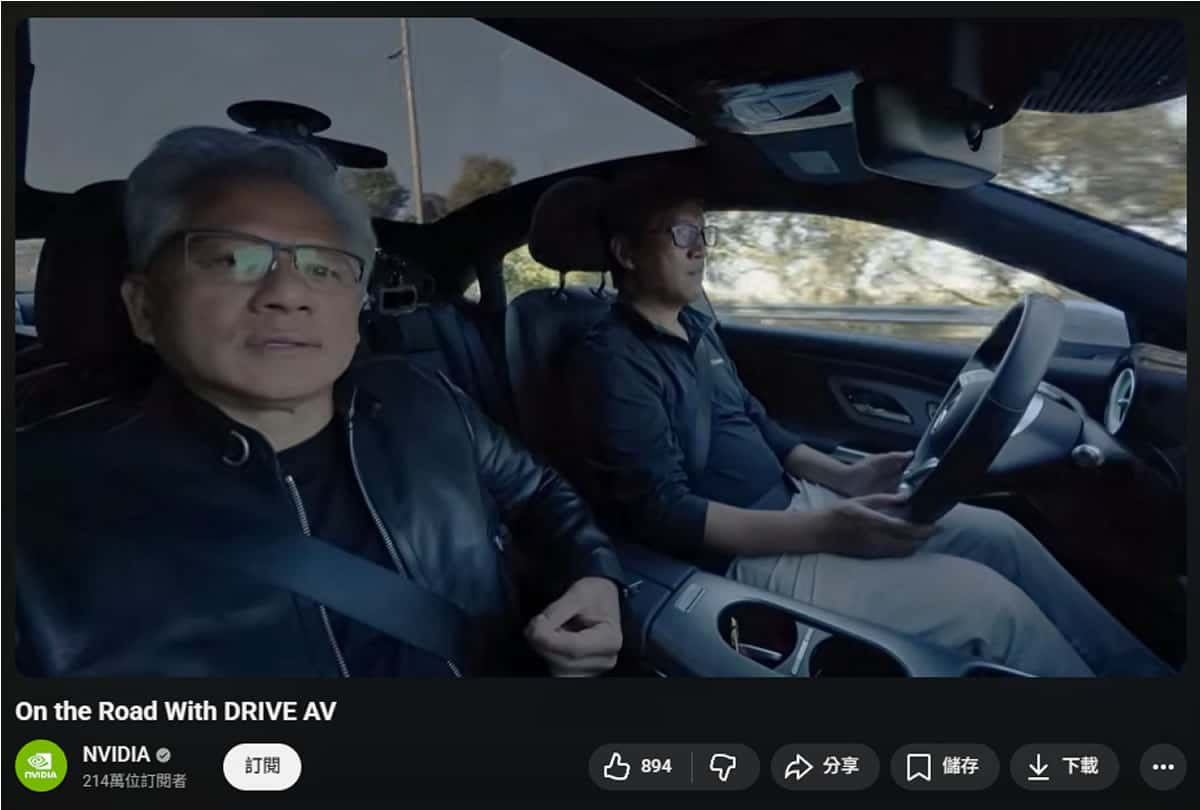

這次 NVIDIA 與賓士(Mercedes-Benz)聯手打造的 AI 輔助駕駛系統 NVIDIA Alpamayo,在 2026 年 CES 正式亮相後,近日一段實測影片在科技媒體間引發高度關注。影片中,NVIDIA 執行長黃仁勳(Jensen Huang)親自坐進一輛銀色賓士 CLA,從加州伍德賽德(Woodside)一路行駛至舊金山市中心,全程 22 分鐘,沒有任何一次需要人工接管。對想了解自動駕駛現況的讀者來說,這段影片值得好好認識它背後的技術故事。

🔔 不錯過任何精彩! 立即訂閱我們的 LINE 官方帳號

每次發佈新文章時,您將會第一時間收到本站文章連結通知,輕鬆掌握最新資訊!

黃仁勳坐進去了:22 分鐘的舊金山實測

這次試乘是由 NVIDIA 汽車事業部副總裁吳新宙(Xinzhou Wu)主導安排的。根據 The Verge 的報導,吳新宙大約每六個月才會邀請黃仁勳試乘一次,條件是他自己對系統有「足夠的信心」才敢發出邀請,可以說這本身就是一種品質把關。這次行程選在交通繁忙的尖峰時段,路線從伍德賽德沿 Highway 84 下山進入市區,沿途包括施工路段、違規併排停靠的車輛,以及被橙色路錐壓縮到極窄的車道。NVIDIA 發言人事後確認,整段行程完全沒有出現任何人工接管,達成百分之百自動行駛。

值得一提的是,這並不是唯一一次媒體實測。根據 CNBC 的報導,NVIDIA 去年 12 月也曾邀請媒體記者在舊金山進行約一小時的試乘體驗,安全駕駛員表示全程約有 90% 的時間由車輛自行駕駛。不過實測中出現了一個插曲:在一條四線道街道上,兩輛公車加上一輛 Waymo 同時試圖通過,兩側還有卡車停靠卸貨,系統一時應對不了,安全駕駛員需要短暫介入倒車等待。這個細節說明 Alpamayo 已經相當成熟,但在最複雜的都市場景下仍有改進空間,對使用者而言是很誠實的參考依據。

" target="_blank" rel="noopener">

Alpamayo 是什麼?會「思考」的自駕 AI

實際上,很多人看到這次試乘新聞,可能搞不清楚 Alpamayo 跟我們常聽到的 Tesla FSD 或 Waymo 到底有什麼不同。根據官網的介紹,NVIDIA Alpamayo 是一套以「視覺-語言-動作模型(Vision Language Action,VLA)」為核心的開放式 AI 平台,在 2026 年 CES 由黃仁勳正式發表。它的核心是一個擁有 100 億個參數的 AI 模型 Alpamayo 1,由 82 億參數的感知推理骨幹加上 23 億參數的軌跡規劃模組組成。

想看該 Alpamayo 這次路測的實際表現全紀錄的人可以觀看這部影片:

對一般讀者來說,最好理解的方式是這樣:傳統的自駕系統像是「反射動作」,看到什麼障礙就做出對應的反應;而 Alpamayo 更像是「會思考的人」,它會在做出駕駛決策之前,先產生一段可以被閱讀的「推理過程」,說明自己為什麼要這樣開。這種能夠解釋決策的能力,對自動駕駛的安全驗證和法規審查來說非常重要。黃仁勳在發表會上說,這就是「實體 AI 的 ChatGPT 時刻,當機器開始理解、推理,並在真實世界中採取行動」。

Alpamayo 的三大支柱:模型、模擬器、資料集

這次 NVIDIA 發布的不只是一個模型,而是一整套開放生態系,包含三個核心組成部分。第一是 Alpamayo 1 模型本身,已開源上架至 Hugging Face,任何開發者都可以下載使用或進行微調。第二是 AlpaSim,這是一套開源的封閉迴路模擬框架,讓工程師可以在虛擬環境中高效率地測試各種極端駕駛情境,大幅減少真實道路測試的需求。第三是實體 AI 資料集,收錄了來自 25 個國家、超過 2,500 座城市的 1,727 小時多感測器駕駛資料,涵蓋七顆攝影機、LiDAR 與雷達的同步紀錄。

對 NVIDIA 來說,這套開放策略有其深遠的戰略意義。這次 JLR、Lucid、Uber,以及柏克萊大學的 DeepDrive 研究團隊都已表態對 Alpamayo 感興趣。對汽車製造商來說,不需要從零開始建立自駕 AI 基礎設施,可以直接在這套平台上進行客製化開發,這正是 NVIDIA 希望成為整個汽車產業「AI 骨幹」的核心佈局。

NVIDIA DRIVE AV 雙堆疊架構:AI 判斷 + 安全兜底

這次搭載在賓士 CLA 上的系統,全名是 NVIDIA DRIVE AV,而 Alpamayo 是它的 AI 推理核心。根據官網的介紹,DRIVE AV 採用雙堆疊架構設計:一套是以 Alpamayo 為基礎的 AI 端到端學習堆疊,負責像人類一樣感知環境、做出自然的駕駛判斷;另一套是傳統的工程化安全堆疊,由 NVIDIA Halos 安全系統提供,負責確保車輛在任何情況下都不會違反安全邊界。兩套系統並行運作、互相補充,一個負責「智慧」,另一個負責「安全兜底」。

對使用者而言,這套設計的實際意義是:當 AI 模型在面對罕見情境時猶豫或判斷出錯,安全堆疊會在後面接住,讓整個系統不會因為單一模型的失誤而失控。這也是 NVIDIA 面對「純端到端 AI 難以做安全驗證」這個痛點,所提出的獨特解法。這次賓士 CLA 已在歐洲新車安全評鑑(EuroNCAP)中獲得五星評級,DRIVE AV 的主動安全功能對此有直接貢獻。

不靠真實里程,靠模擬決勝負

面對 Waymo 累積數億英里、Tesla FSD 累積數十億英里的真實道路資料優勢,NVIDIA 選擇了一條不同的路。吳新宙直言:「真正的基礎設施是仿真。」NVIDIA 利用神經重建(NuRec)技術,從真實駕駛資料中 1:1 重建場景,再透過 Omniverse 和 Cosmos 平台在虛擬世界中批量生成各種極端情況,讓真實的幾萬英里資料變成虛擬世界的數十億英里訓練素材。

實際上,這套「以模擬取代里程」的策略有它的邏輯:真實道路上的危險情境很難被安全地大量收集,但在模擬器裡可以無限複製,讓模型反覆學習如何應對。黃仁勳用了一個有趣的比喻:我們教孩子開車,不是讓他先開幾萬公里,而是先讓他理解交通規則,再進行約 20 小時的上路練習。NVIDIA 希望 Alpamayo 也能做到這件事,透過語言和視覺的理解力,從根源上「懂得」如何開車,而不只是靠大量資料記住反應模式。

賓士 CLA 搭載 MB.Drive Assist Pro:這套系統要多少錢?

這次搭載 NVIDIA DRIVE AV 的車款是全新賓士 CLA,也是賓士首款搭載 MB.OS 平台的量產車型。這次啟用的輔助駕駛功能叫做 MB.Drive Assist Pro,支援點對點城市導航、主動偵測行人與自行車騎士並提前反應、狹窄空間自動停車,以及駕駛人與系統之間的協作式轉向。此外,這套系統支援 OTA 空中更新,未來的新功能可以直接推送到車上,不需要回廠升級。

根據 Car and Driver 的報導,MB.Drive Assist Pro 的訂閱費用為三年方案 3,950 美元(約台幣 12.9 萬元),也提供月租制選項。根據官網的介紹,這套系統預計 2026 年內在美國率先上線,初期以東西岸主要都會區為主要服務範圍,隨後歐洲和亞洲市場也會陸續跟進。對台灣消費者來說,雖然短期內可能還等不到本地上路,但這套系統的技術路線正在快速成熟,它的競爭者,Tesla FSD 和 Waymo,已經讓我們看到這個時代的輪廓。

三強鼎立:NVIDIA、Tesla、Waymo 誰才是正確答案?

這次 Alpamayo 的登場,讓自動駕駛市場正式形成三條清晰的技術路線。Tesla FSD 走封閉式純神經網路路線,優勢是極低延遲和對消費級硬體的高度優化,已有數億英里的真實道路資料支撐;Waymo 則是以 L4 完全自動駕駛為目標,在特定城市區域提供無人計程車服務,目前是商業落地最成熟的玩家。NVIDIA Alpamayo 的差異在於它是開放平台,任何車廠都可以在這套基礎上開發自己的自駕功能,加上「可解釋的推理過程」讓監管機構更容易審查,這對追求 L4 認證的車廠來說是重要優勢。

對台灣讀者來說,這三條路線並不互斥,未來我們看到的量產車很可能會混搭不同廠商的技術。NVIDIA 這次和賓士的合作,前後投入了數千名工程師、歷時至少五年,黃仁勳形容這是一個「垂直整合的完整技術棧」。這次 22 分鐘的舊金山零接管影片,或許只是這場競賽中的其中一個里程碑,但它確實讓我們看到:AI 自動駕駛不再只是實驗室裡的概念,它正在真實的城市街道上行駛。

資料來源:NVIDIA 官方部落格、NVIDIA Alpamayo 官網、The Verge、CNBC、TechCrunch、Car and Driver